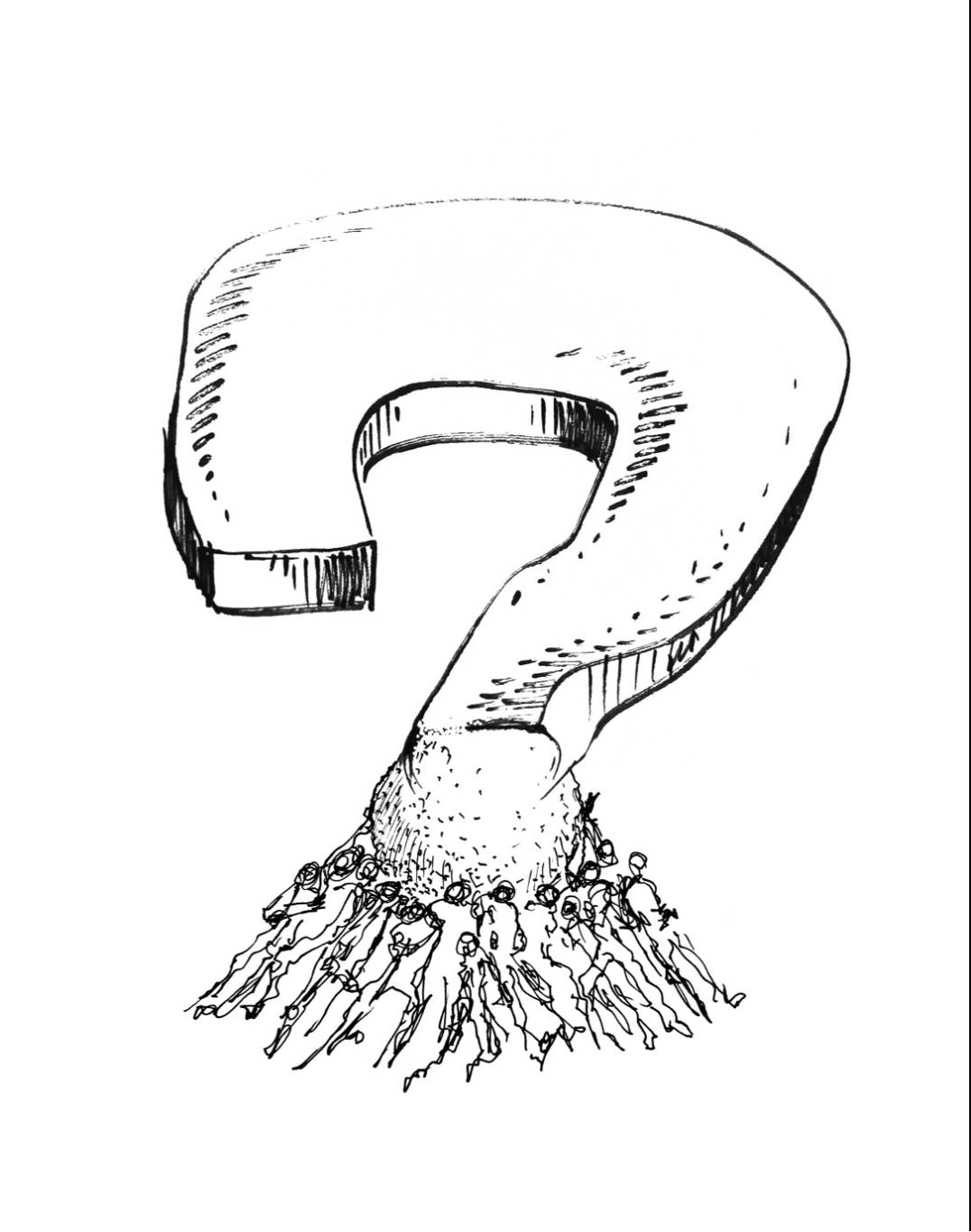

Illustration Joseph el-Hourany

Si vous demandez à ChatGPT : « Pouvez-vous poser des questions ? » Ça vous répondra : « - Oui, je peux poser des questions. Avez-vous une question spécifique afin que je la pose ?

- Pouvez-vous interroger votre savoir ?

- En tant que modèle de langage, je n’ai pas la capacité de m’interroger comme peuvent faire les humains. Je repose sur des algorithmes et des modèles prédéfinis (…) »

Nous voilà face à la différence entre poser une question et la soulever. Ça – l’intelligence artificielle – peut poser une question sous forme de réponse à une question, mais ça ne peut pas la produire. La réponse est forcément inerte. Une fois posée, ça ne peut pas la soulever. Son savoir, c’est pareil. Ça peut le décliner sous plusieurs versions, ça ne peut pas l’interroger. Ça peut en peser le pour et le contre, ça ne peut pas le soupeser. Ça peut assurer l’aller-retour de la question à la réponse, ça ne peut rien voir d’autre en chemin. Ça peut émettre un doute, ça ne peut pas douter. Ça peut revenir sur ce que ça a proposé, ça ne peut rien prévoir. Ça ne connaît ni le biais ni la sublimation. Si bien qu’outre l’absence de conscience, c’est aussi l’absence d’inconscient qui rend ça redoutablement dangereux. En somme, le « Ça » de ChatGPT est l’exact contraire du « Ça » de Freud. Le premier classe ce qu’il engrange puis dégaine, le second délivre des contenus puis cède la place au sujet. L’un répond aux questions. L’autre les pose. Que vaut la réponse à une question que l’on ne se pose pas ? La question mérite d’être posée et, si possible, soulevée.

Joseph El-Hourani lui, essaie de soulever la question!!!!! Un dessin en forme d'interrogation! Génial...Bravo

04 h 32, le 25 septembre 2023